学计算机

原标题:新中国刑法学创始人之一朱华荣在上海病逝,曾任江青辩护律师沉痛悼念华东政法大学著名刑法学者朱华荣教授因肺部感染于2018年2月15日早上6:38分在华山医院仙逝。享年89岁。先生千古,谨以此文缅怀朱华荣教授。朱华荣,1929年1月26日出生,四川省璧山县人。1948年秋毕业于四川大学法律系,获法学士学位。1951年8月被保送到中国人民大学法律系学习。1953年2月被抽调到中国人民大学刑法教研室任教员,研究苏联刑法,并负责筹建中国刑法教程,成为新中国刑法学的创始人之一。1958年被错划成“右派”,调往资料室。1963年被下放支援安徽芜湖,先后在中小学任教,直到1978年恢复重建华东政法学院,被调往上海任教。1982年参加司法部领导的“审判林彪、江青反革命集团”律师组工作,被特别法庭指定为江青的辩护律师。此后任华东政法学院教授、研究生导师。主要学术研究方向为中国刑法学、中国古代刑法史、比较刑法学和法律思想史。发表专业学术论文100余篇,出版、参编《中华人民共和国刑法总则讲义》《各个刑法比较研究》《中国刑法通史》《中国法律思想史》等著作。家学渊源家风传“天下之本在国,国之本在家,家之本在身。”习近平总书记把良好家风的传承看得很重,曾多次学计算机

原标题:新中国刑法学创始人之一朱华荣在上海病逝,曾任江青辩护律师沉痛悼念华东政法大学著名刑法学者朱华荣教授因肺部感染于2018年2月15日早上6:38分在华山医院仙逝。享年89岁。先生千古,谨以此文缅怀朱华荣教授。朱华荣,1929年1月26日出生,四川省璧山县人。1948年秋毕业于四川大学法律系,获法学士学位。1951年8月被保送到中国人民大学法律系学习。1953年2月被抽调到中国人民大学刑法教研室任教员,研究苏联刑法,并负责筹建中国刑法教程,成为新中国刑法学的创始人之一。1958年被错划成“右派”,调往资料室。1963年被下放支援安徽芜湖,先后在中小学任教,直到1978年恢复重建华东政法学院,被调往上海任教。1982年参加司法部领导的“审判林彪、江青反革命集团”律师组工作,被特别法庭指定为江青的辩护律师。此后任华东政法学院教授、研究生导师。主要学术研究方向为中国刑法学、中国古代刑法史、比较刑法学和法律思想史。发表专业学术论文100余篇,出版、参编《中华人民共和国刑法总则讲义》《各个刑法比较研究》《中国刑法通史》《中国法律思想史》等著作。家学渊源家风传“天下之本在国,国之本在家,家之本在身。”习近平总书记把良好家风的传承看得很重,曾多次学计算机

新华社今日发布《中国共产党中央委员会关于修改宪法部分内容的建议》,建议社会主义民族关系增加“和谐”表述,原文如下:三、宪法序言第十一自然段中“平等、团结、互助的社会主义民族关系已经确立,并将继续加强。”修改为:“平等团结互助和谐的社会主义民族关系已经确立,并将继续加强。”学计算机

原标题:防护性能堪忧?外媒拆解索尼A7RIII

索尼A7RIII在画质、连拍、高感等方面有着出众且均衡的性能表现,这一点相信各位读者已经有目共睹,不过关于这款顶级无反的防护及耐候性则还并没有一个明确的说法。近日,Lensrentals网站的RogerCicala针对这款相机进行了拆解展示,我们一起来看看结果吧(拆解图片均来自Lensrentals网站)。

Lensrentals网站拆解索尼A7RIII

揭开手柄蒙皮,可以看到机身密封性非常好

电池仓盖采用橡胶垫进行全密封处理

从RogerCicala的拆解体验来看,索尼A7RIII比起上一代的A7RII而言,在机身做工以及密封性上有着非常大的突破。拆解过程中,A7RIII在手柄接缝、电池仓、卡槽、电子取景器等这些易于进水的部位都做了非常细致的密封处理,大量防水胶圈、橡胶垫的使用让其有着不俗的防护能力。不说防水,起码面对常规的小雨、滴溅问题时都可以从容应对。

卡槽处也加入了密封橡胶垫

电子取景器内部接缝处,均采用橡胶垫进行全密封

除了防护性能提升之外,可以看到这款相机的内部构造非常复杂,快门、传感器以及各类组件花样繁多。索尼能够将众多繁琐的元件装进一个如此小巧的机身,并且提供了不俗的做工及周边防护性,足见索尼在微单制造学计算机

原标题:防护性能堪忧?外媒拆解索尼A7RIII

索尼A7RIII在画质、连拍、高感等方面有着出众且均衡的性能表现,这一点相信各位读者已经有目共睹,不过关于这款顶级无反的防护及耐候性则还并没有一个明确的说法。近日,Lensrentals网站的RogerCicala针对这款相机进行了拆解展示,我们一起来看看结果吧(拆解图片均来自Lensrentals网站)。

Lensrentals网站拆解索尼A7RIII

揭开手柄蒙皮,可以看到机身密封性非常好

电池仓盖采用橡胶垫进行全密封处理

从RogerCicala的拆解体验来看,索尼A7RIII比起上一代的A7RII而言,在机身做工以及密封性上有着非常大的突破。拆解过程中,A7RIII在手柄接缝、电池仓、卡槽、电子取景器等这些易于进水的部位都做了非常细致的密封处理,大量防水胶圈、橡胶垫的使用让其有着不俗的防护能力。不说防水,起码面对常规的小雨、滴溅问题时都可以从容应对。

卡槽处也加入了密封橡胶垫

电子取景器内部接缝处,均采用橡胶垫进行全密封

除了防护性能提升之外,可以看到这款相机的内部构造非常复杂,快门、传感器以及各类组件花样繁多。索尼能够将众多繁琐的元件装进一个如此小巧的机身,并且提供了不俗的做工及周边防护性,足见索尼在微单制造学计算机

原标题:这里有一篇深度强化学习劝退文 雷锋网 AI 科技评论按:本文作者 Frankenstein,首发于作者的知乎主页,雷锋网 AI 科技评论获其授权转载。 今天在学校又双叒叕提到了 Deep Reinforcement Learning That Matters 这篇打响 DRL(Deep Reinforcement Learning, 深度强化学习)劝退第一枪的文章后,回来以后久违刷了一下推特,看到了这篇爆文 Deep Reinforcement Learning Doesn't Work Yet,或可直译为深度强化学习还玩不转或意译为深度强化学习远不能即插即玩。 看完以后很多从自己去年七月入坑以来隐隐约约的困惑都得到了解答。读完大有如不见此文,万古如长夜之感。心里激动,一时难以自抑。知乎上深度强化学习的内容比较少,最好的私以为是智能单元,此外还有许多零散的论文介绍、课程笔记、问答等等,但好像没人提过这篇文章。这篇文章是我入坑以来看到的深度强化学习方面最好的阶段性总结,强烈建议应该作为深度强化学习的第一课,看完以后大家再慎重考虑到底要不要入坑。 先看一下作者的背景。作者叫 Alex Irpan,现为谷歌大脑机器人团队的软件工程师。他从伯克利拿到的计算机科学本科学位,本科的时候曾经在伯克利人工智能实验室学计算机

原标题:从LeNet到SENet——卷积神经网络回顾

雷锋网 AI 科技评论按:本文为浙江大学范星为雷锋网 AI 科技评论撰写的独家稿件,未经雷锋网许可不得转载。

从 1998 年经典的 LeNet,到 2012 年历史性的 AlexNet,之后深度学习进入了蓬勃发展阶段,百花齐放,大放异彩,出现了各式各样的不同网络,包括 LeNet、AlexNet、ZFNet、VGG、NiN、Inception v1 到 v4、Inception-ResNet、ResNet、WRN、FractalNet、Stochastic Depth、DenseNet、ResNeXt、Xception、SENet、SqueezeNet、NASNet、MobileNet v1和v2、ShuffleNet 等等。

它们各有特点,也互相借鉴,在很多任务上不断取得突破。本文从最基本的分类任务的角度,从无人问津到 ImageNet 上超越人类,回顾了卷积神经网络的发展历史。

经典网络

经典网络包括 LeNet、AlexNet 以及 VGG 等。

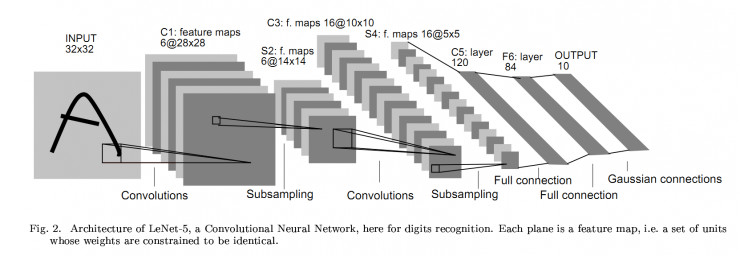

LeNet:1998,Gradient based learning applied to document recognition

用于手写数字识别,可以看到,卷积神经网络的基本框架已经有了,卷积、激活、池化和全连接,这几个基本组件都完备了。

但是,在 1998 年以后,深度学习并没有太多的突破。一直沉寂到 2012 年,AlexNet 横空出世学计算机

原标题:从LeNet到SENet——卷积神经网络回顾

雷锋网 AI 科技评论按:本文为浙江大学范星为雷锋网 AI 科技评论撰写的独家稿件,未经雷锋网许可不得转载。

从 1998 年经典的 LeNet,到 2012 年历史性的 AlexNet,之后深度学习进入了蓬勃发展阶段,百花齐放,大放异彩,出现了各式各样的不同网络,包括 LeNet、AlexNet、ZFNet、VGG、NiN、Inception v1 到 v4、Inception-ResNet、ResNet、WRN、FractalNet、Stochastic Depth、DenseNet、ResNeXt、Xception、SENet、SqueezeNet、NASNet、MobileNet v1和v2、ShuffleNet 等等。

它们各有特点,也互相借鉴,在很多任务上不断取得突破。本文从最基本的分类任务的角度,从无人问津到 ImageNet 上超越人类,回顾了卷积神经网络的发展历史。

经典网络

经典网络包括 LeNet、AlexNet 以及 VGG 等。

LeNet:1998,Gradient based learning applied to document recognition

用于手写数字识别,可以看到,卷积神经网络的基本框架已经有了,卷积、激活、池化和全连接,这几个基本组件都完备了。

但是,在 1998 年以后,深度学习并没有太多的突破。一直沉寂到 2012 年,AlexNet 横空出世学计算机